Drauzio Varella vítima de Deep Fakes: Entenda como a IA cria falsificações convincentes

Estamos vivendo na era da informação, onde quase todos têm acesso à internet e às várias informações que ela fornece. Entretanto, isso também tem um lado negativo: o aumento da desinformação e, atualmente, os chamados deep fakes.

- Publicidade -

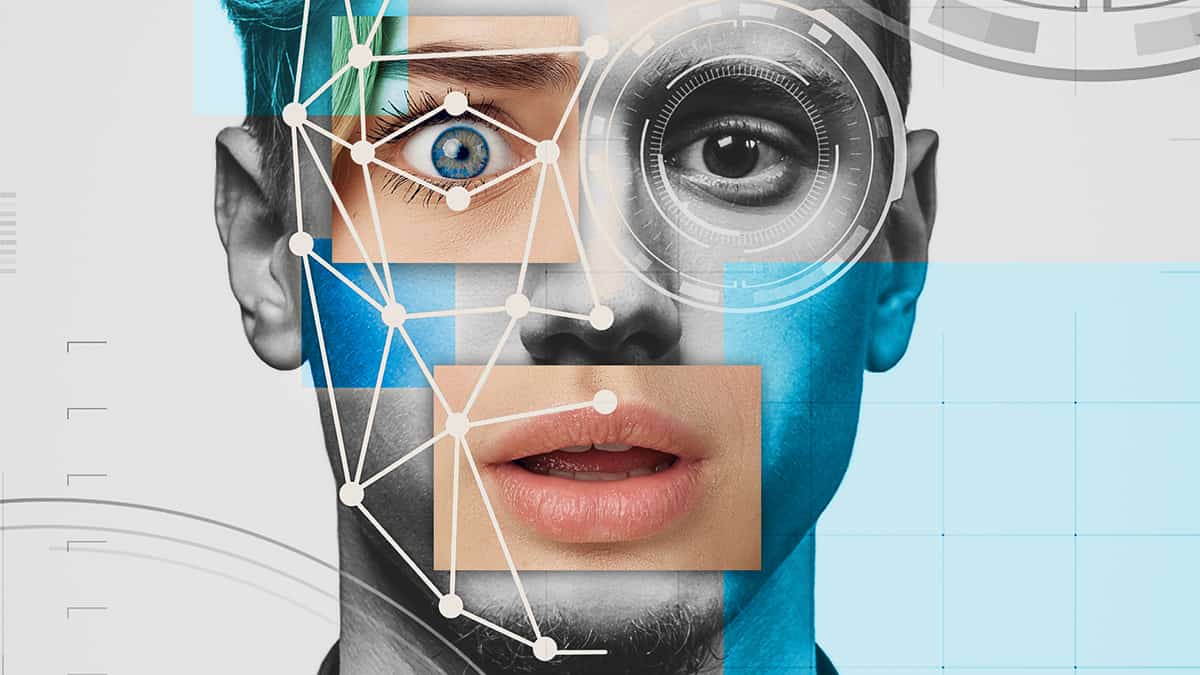

Deep fakes são vídeos ou áudios falsos que, através do uso de Inteligência Artificial (IA), conseguem recriar a voz ou a imagem de uma pessoa com alta qualidade e semelhança ao original. Embora essa tecnologia possa ter aplicações benéficas, como a criação de conteúdo de entretenimento digital, também pode ser usada para fins maliciosos.

Leia mais:

Adolescente vítima de bullying e homofobia abre fogo em escola, mata uma e fere dois

- Publicidade -

Ataque em escola desperta alerta: Lula condena fácil acesso de jovens a armas

Como a IA é usada na criação dos deep fakes?

O processo de criação de um deep fake começa com a IA aprendendo a voz ou as características faciais da pessoa que será falsificada. Ela faz isso escutando vários minutos de áudio ou podcasts ou analisando várias imagens e vídeos. Quanto mais dados a IA tem acesso, melhor é o resultado obtido.

Após a aprendizagem estar completa, a IA pode gerar uma voz ou uma face completamente nova que se parece com a pessoa estudada. Essa nova voz ou face é então usada para criar um vídeo ou áudio adulterado, podendo levá-lo a acreditar que está assistindo ou ouvindo a pessoa real.

O exemplo recente de Drauzio Varella

- Publicidade -

Um exemplo recente disso é um vídeo deep fake do famoso médico Drauzio Varella que circulou no TikTok. No vídeo, Drauzio parece estar divulgando um produto para a pele. Entretanto, o vídeo era falso, criado usando tecnologia de IA.

Infelizmente, esse tipo de conteúdo falso é cada vez mais comum, levantando preocupações sobre a disseminação de desinformação e a violação de direitos de imagem.

A Regulamentação do Uso da IA e Deep Fakes

São necessárias regulamentações e leis que lidem diretamente com esta questão. Há dois projetos de lei sendo analisados no Brasil, o projeto de lei 2338/23 e o PL 4025/23, que tratam do uso da IA e da necessidade de autorização expressa das pessoas para o uso de suas imagens e vozes.

Além disso, requerem que o usuário saiba claramente quando está interagindo com um conteúdo gerado por IA. Embora essas leis sejam um bom começo, ainda há muito a ser feito para combater o problema dos deep fakes.

Como a tecnologia e a IA continuam a avançar, é essencial que também avancemos na criação de regulamentações e sistemas de proteção. Precisamos equilibrar a promoção da inovação com a proteção de nossos direitos e interesses públicos.